Il y a quelques semaines, nous vous avions présenté les travaux de recherche de plusieurs scientifiques qui utilisaient les énormes possibilités de l’Intelligence Artificielle pour permettre à des robots de dresser eux-mêmes une table par l’injonction de texte et par la reconnaissance d’images.

D’autres chercheurs de Google Research ont présenté dans un article scientifique paru en août 2022, une approche originale combinant les mêmes technologies mais avec un objectif différent.

L’IA appliquée comme nous l’appelons chez Sedona est de plus en plus usitée dans le traitement de l’image et du texte. Des technologies Open Source comme DAL-E 2 permettent à tout à chacun de créer des images à partir d’une description textuelle que l’on fournirait en « entrée ».

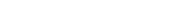

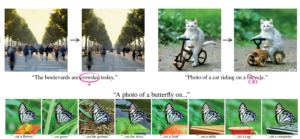

Les chercheurs de Google ont souhaité aller plus loin dans le concept en proposant de substituer une image générée par une phrase, par une autre associée à une seconde phrase mais qui s’intégrerait naturellement dans l’image d’origine.

Par exemple, supposons que nous demandions au système de nous générer une photo d’un chat sur un vélo, le système produira une image adaptée basée sur sa connaissance acquise au fil de son apprentissage (ML). A partir de cette image, nous indiquons maintenant que nous souhaitons que le chat soit sur une voiture, le système effectuera alors un remplacement de l’objet « Vélo » par l’objet « Voiture » sans altérer l’image d’origine mais en substituant l’image graphique de l’objet concerné.

Cette approche utilise les principes de l’édition d’image qui permet d’isoler les différents éléments de celle-ci pour les catégoriser (chat, vélo, voiture).

A partir de cette première analyse, le système va détourer l’image (via l’usage de multiples masques) pour isoler les objets correspondant au mot issu de l’analyse sémantique de notre phrase. Il cherche à cette occasion un objet « graphique » le plus approchant possible de l’objet d’origine (en terme de dimensions, de couleurs, de poids,…) dans sa base de connaissances associée au mot.

Il applique ensuite l’intégration de l’image (sous forme de pixels) dans une nouvelle via la combinaison d’algorithmes basés sur l’approche « Gaussienne » (afin d’éliminer les fameux « bruits » associés à l’image).

Les applications d’une telle technologie sont multiples : On pourra changer par une simple phrase n’importe quel objet présent sur une image (comme nous le faisons maintenant par exemple, pour ôter une « personne » qui serait présente sur notre photo de vacances en indiquant manuellement la zone à « nettoyer ») mais je pourrais également demander au système de me rajouter des personnes sur la photo de ma conférence d’origine pour « gonfler » quelque peu mon audience.

Les dérives du Deep Fake ne sont pas très loin…